NotebookLMでの情報取集・整理の流れ

日常生活や仕事で、新しい知識を身につける必要が生じることが良くありますよね。

ところが、必要な情報の所在がわかりづらかったり、逆に情報量が多すぎてどこから調べればよいのか迷うことも少なくありません。そんな場面で頼りになるのが、NotebookLM です。

NotebookLMは、複数の資料を横断的に分析・要約する能力に優れていますが、その最大の特長は、ユーザーが指定したソース(あなたの指定したドキュメントやWEBサイトなどの情報源)のみに基づいてアウトプットを生成するという点です。ソースのみを情報源として回答を返すため、誤情報の生成(ハルシネーション)を避けやすいため、特に正確な情報を把握したい時に最適です。

本記事では、NotebookLMを使って知らない分野の情報をどのように収集し、どのように深掘りしていくのか、その一例を紹介します。

今回は2016年に元Googleのエンジニアにより設立されたAIスタートアップ企業Groqについて調査をしてみました。

NotebookLMのことが良くわからない、聞いたことがあるけど使い方がわからないという方は、「【インプレ:NotebookLM】効率的な知識習得1/2」を参考にして下さい。

💡 記事を記載した時期について

この記事は、2025年12月にNVIDIAとGroqの間の非独占的なテクノロジーライセンスの契約締結(NVIDIAによるGroqの事実上の買収?)が発表される前の情報をベースに記載しています。現在の最新の状況とは一部異なる可能性がある点をご了承ください。

NotebookLMでの情報取集・整理の流れ

NotebookLMの画面は、ソースエリア(画面左)、チャットエリア(画面中央)、スタジオエリア(画面右)に分かれています。

この3つのエリアを行き来し、情報収集と整理を行っていきます。

Step 1:ソースエリアにGroqの公式サイトを追加

NotebookLMで新規ノートを作り、Groq の公式URL(https://groq.com)を読み込ませます。NotebookLMは、このソースだけを参照して分析します。ここがハルシネーション(推測)を避ける最大のポイントです。(注意:URLでサイトを指定した場合、そのページからリンクしている先の情報は読み込みません。もしリンク先の情報が必要な場合は、その情報もソースで指定し読み込んでください。)

Step 2:スタジオエリアでレポートを自動生成

スタジオエリアでは、「音声解説」、「動画解説」、「レポート」などのボタンが用意されており、このボタンをクリックすることでソース情報をサマライズしたコンテンツが自動で生成されます。今回は「レポート」(の中の「概要説明資料」)を使用し、Groqのホームページの概要をまとめてもらいました。その主な内容は、

大規模言語モデル(LLM)の推論性能を向上させることに特化したLPUと呼ばれるAIアクセラレータを開発・提供しているアメリカのAI企業

そのLPUを基盤としたGroqCloudサービスを通じて、顧客に高速安価なLLMの推論サービスを提供。 開発者はクラウドベースのAPIを通じてGroqの高性能ハードウェアにアクセスし、カスタムAIアプリケーションを構築できる。

OpenAIのAPIを使用していれば、わずか2行のコード変更でGroqCloudサービスに切り替えられる

Groqは2025年9月に7.5億ドルの資金調達を実施し、高速・低コストなAI推論基盤のワールドワイドへの展開を加速。

といった内容でした。これらは、ソース(今はGroqのホームページの情報のみ)に基づいた信頼度の高い情報のみで構成されている点が最大の利点です

生成されたコンテンツをソース情報として登録することも可能です。これらのコンテンツは元のソース群の情報を特定の視点や構成でまとめたものです。

それをソースに加えることで、「元の生データ」と「整理・要約された見解(レポート)」の両方をAIが参照し、より複合的・多角的な分析や質問応答が可能になります

Step 3:チャットエリアで深掘りする

ホームページの要約の情報を見ていく中でいくつか疑問が出てきました。そこで、チャットエリアを利用しNotebookLMにいくつか質問をしました。そのやり取りの要約を見ていきましょう。

Groqは、LLMの推論専用チップ「LPU」を基盤にしたクラウド推論サービス「GroqCloud」の利用料が主要な収益源です。高速かつ低コストの推論サービスを提供し、企業や開発者がAPI経由でそれを利用します。公式サイトでは価格情報や顧客事例が確認でき、速度向上や大幅なコスト削減が価値として示されています。ビジネスモデルは推論処理の提供に特化しています。

GroqCloudは、LPUを活用した推論インフラをクラウド経由で提供するサービスで、開発者はAPIキーを使ってOpenAI互換形式で利用できます。インフラは世界中のデータセンター上で稼働し、低遅延な推論を実現します。システムは既存コードをわずかに変更するだけで導入でき、スピードとコスト効率の両立を強みとしています。

ご質問いただいたデータセンターの具体的な管理・運営形態について、ソースは明確な情報を提供していません。

この回答こそが、一般的な生成AIとは異なるNotebookLMならではの特長を示しています。一般の生成AIでは、学習データの情報から確率の高い語句の並びを生成し、その結果誤情報となる(ハルシネーションを起こす)可能性がありますが、NotebookLMは知らないものは知らないとはっきり断言します。

今はソースにGroqのホームページの情報しか与えていないので、NotebookLMに追加の情報源を与えることにしました。

そこでソースエリアに移り、下記のプロンプトで検索を依頼しました。

「 GroqのLPUがどのデータセンターに設置されているか(具体的な場所や運営元)が分かる情報を検索して下さい。

検索は、

- Groq公式サイトやプレスリリースなど、企業自身による一次情報

- 政府機関・大学・研究機関などの公的・学術的な組織による発表資料

- 複数の独立した信頼筋(大手の業界メディア/報道機関/専門誌など)で同様の内容が確認できる情報

など、信頼性の高い情報源に限定して下さい。

正確な情報を把握したい時には信頼度不明の情報を指定しないことです。ソースに信頼性が低い情報が混ざると、NotebookLMが生成するアウトプットにも、その信頼度の低い情報が反映されてしまいます。

サーチを依頼すると、NotebookLMは10件のソースを提案してきました。それらをざっと見渡し、信頼度の低そうな情報が無いことを確認した後にソースに追加しました。改めて、先ほどと同様の質問をしてみました。

追加ソースに基づくと、Groqは外部のデータセンター事業者(コロケーションプロバイダーや通信事業者)の施設を利用し、その中に自社のLPUベースのインフラを配置しています。Equinix、DataBank、Bell Canadaなどの施設に展開された事例が確認でき、自社で施設全体を運営している情報はソースにはありません。

AI推論特化型チップはCerebras、FuriosaAI、Positron、SambaNovaなど多くの競合が存在します。Groqの特徴として「決定論的アーキテクチャによる超低遅延」「高いコスト効率」「OpenAI互換による導入の容易さ」が他の企業に比べ秀でています。

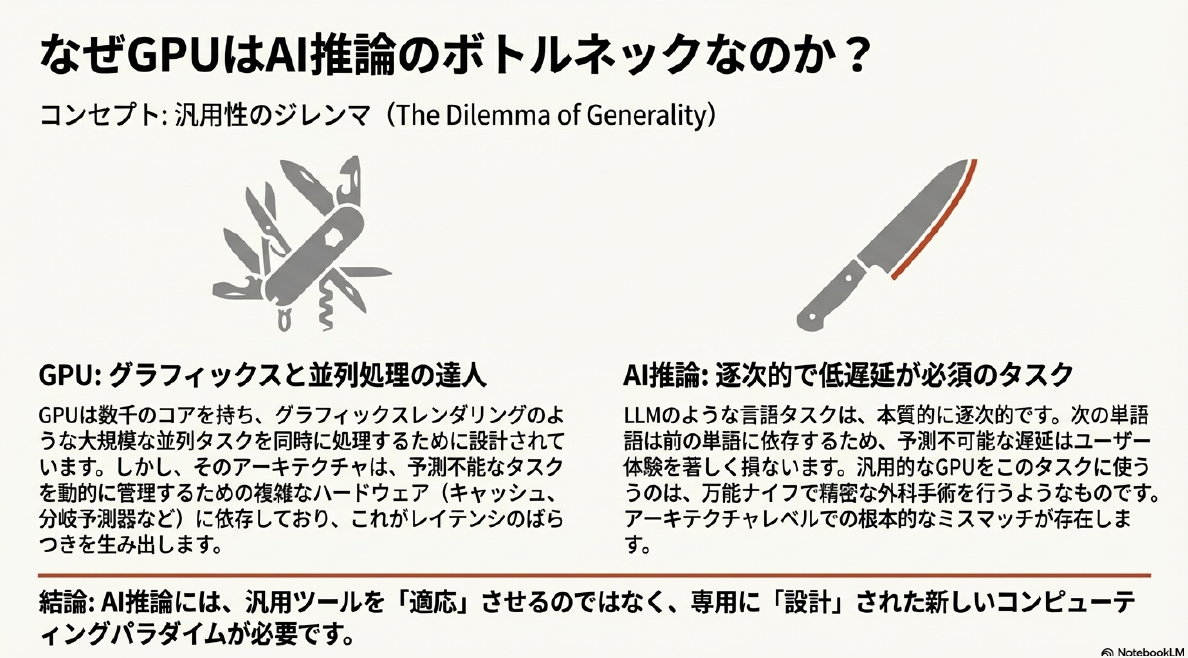

Groqが「高性能・低コスト」を実現できる理由は、GPUとも他社ASICとも異なる決定論的アーキテクチャと垂直統合モデルにあります。キャッシュや分岐予測を排したLPUはレイテンシが予測可能で高速処理に特化し、オンチップSRAMにより大幅な帯域幅向上を実現。さらに成熟プロセス(14nmプロセス)の採用やHBM非依存によって製造コストを抑え、高いエネルギー効率で運用費も低減しています。加えて、ハードからクラウドサービスまで一体で提供することで中間コストを排除し、LLM推論に最適化された低コスト運用を可能にしています。

以上のことからGroqの特長は

LLM推論専用チップ「LPU」を基盤にクラウド推論サービスを提供する企業

主な収益源は、LPUを使った推論を利用できる「GroqCloud」のAPI利用料。GroqCloudを通じて高速・低コストの推論を提供し、OpenAI互換APIで導入しやすい

開発者は少ないコード変更で利用できる点が特徴。外部データセンター事業者の施設にLPUインフラを配置して運用

Equinix、DataBank、Bell Canada などの施設で展開されていることがソースから確認できる(自社運営施設の記載は無し)。LLM(大規模言語モデル)の推論処理に用途を絞り込み、処理の高速化を実現するだけでなく、上流の設計段階からハードウェア実装コストの低減を可能とするメモリシステム設計を採用することで、高い処理性能と低コストを両立し、他社より優れた強みを発揮している。

ということがわかりました。

NotebookLMにソースを設定してから、このようなやり取りをするのにかかったのは10分程度。非常に効率的に情報収集・理解を進めることができました。

最後にスタジオエリアに戻り、「スライド資料」の機能を使いスライドを生成してみました。今(2025年末)現在ベータ版の機能ですが、資料の出来栄えは素晴らしいです。代表的なスライドをあげておきます。

スライドその3:GroqCloudのグローバル展開と戦略的パートナーシップ

今回、情報ソースを全て利用し、スライドを作成しましたが、例えば、

とすると、あなたが調べた内容に特化したスライドを生成してくれます。

調べた内容を第三者に伝えたい時に、資料作成する手間も省くことができますね。

さいごに

NotebookLMの特長を改めて振り返ると、

- ソース限定でハルシネーションを防げる

- ソースにアップロードした資料は学習に使用されず情報が漏れない

- 概要把握と深掘りが1つの画面で完結

- レポート生成により、調べた内容を第三者にも結果を共有できる

今回は、調べたい内容が未知のものであり、情報ソースも十分でない状況を出発点として、必要に応じて情報を徐々に追加していく形で調べていきました。

この他にも、「複数の長文資料の横断検索・要約」や「業界レポートなどをもとに競合分析」するなど、様々な使い方ができます。NotebookLMに触れたことのない方は一度試してみてはいかがでしょうか。